Calo di traffico organico: cosa devi fare quando il tuo sito perde quota?

Ok, niente panico! Prima o poi capita a tutti di trovarsi in una situazione simile quindi fai un bel respiro profondo e proviamo a capire insieme perché il traffico organico del tuo sito web è crollato improvvisamente.

Quello che ti propongo di seguito è una serie di controlli fondamentali per verificare la causa di cali nei trend di dati. Per ogni controllo ti suggerirò un tool da consultare in modo da facilitarti il lavoro di analisi.

Segui passo passo questi step e con buona probabilità arriverai a individuare il colpevole!

Indice — che ti può sempre servire

- Verifica della stagionalità

- Controllo dei tracciamenti analytics

- Verifica su Google Search Console

- Problemi di scansione da parte dei bot

- Problemi di indicizzazione

- Presenza di contenuti duplicati

- Migrazione mal gestita

- Mobile-friendliness

- Aggiornamenti delle SERP

- Penalizzazione manuale

- Cannibalizzazione paid

Verifica della stagionalità

Tool: Google Trends, Google Ads Keyword Planner.

La prima domanda che devi farti è: potrebbe essere un calo legato alla stagionalità? Potrà sembrare banale, ma a volte capita di dimenticarci che l'andamento del nostro sito può essere fortemente influenzato dall'andamento del mercato e una diminuzione di interesse dei nostri utenti verso un argomento centrale per il nostro sito può comportare flessioni o, al contrario, incrementi significativi.

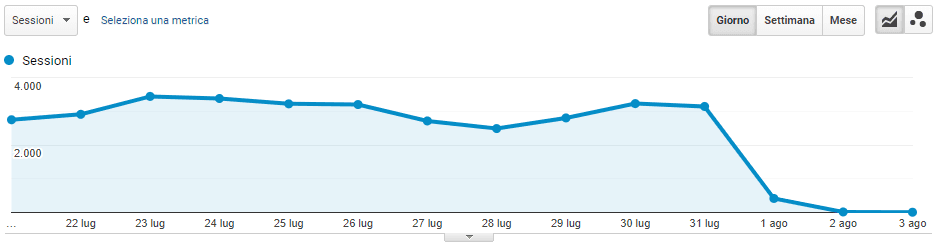

Prendiamo, ad esempio, il settore delle crociere. L'interesse delle persone verso un viaggio in crociera non è costante durante tutto l'anno ma, tipicamente, si fa più forte in periodi specifici, come a ridosso dei mesi estivi e a inizio anno. Questa tendenza ci viene confermata dall'analisi delle ricerche degli utenti sul periodo di un anno:

Per verificare la presenza di stagionalità di mercato, ti consiglio di andare su Google Trends, impostare il mercato di riferimento (Paese), digitare una parola chiave particolarmente rilevante per il settore del tuo sito e visualizzare l'eventuale trend di interesse nell'arco di 12 mesi o più. Se dovessi individuare una depressione in corrispondenza del calo registrato dal tuo sito, allora potrebbe anche esserci una seppur minima correlazione tra i due eventi.

Controllo dei tracciamenti analytics

Tool: Google Analytics, Adobe Analytics, Tag Manager (estensione browser).

Al di là della stagionalità, il primo controllo da effettuare consiste nel verificare l'eventuale presenza di errori di tracciamento nei codici analytics. Lo scopo è accertarsi che gli strumenti di web analytics non riportino dati sbagliati (se così fosse si tratterebbe dunque di un falso allarme).

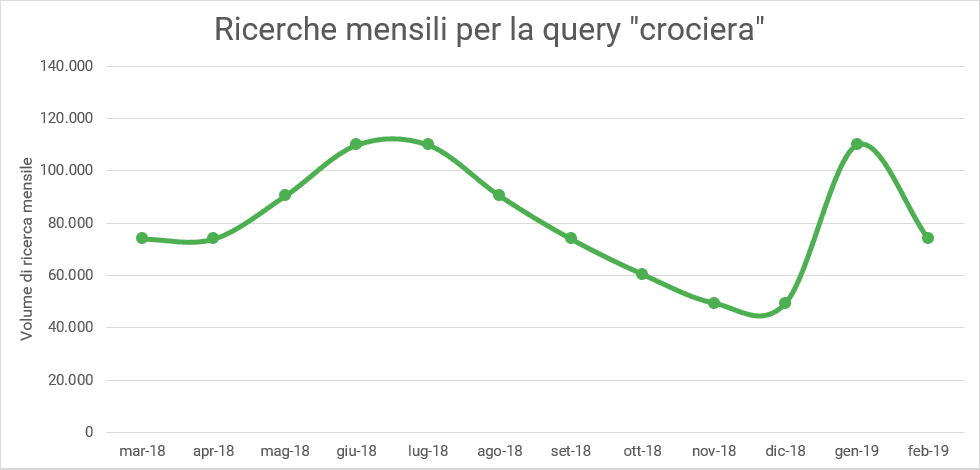

Accertarsi che il codice di monitoraggio della tua property sia settato correttamente su Google Analytics è molto semplice: apri la sezione Amministratore, cerca la voce Informazioni di monitoraggio > Codice di monitoraggio nel pannello della property e clicca il pulsante Invia traffico di prova (una nuova finestra si aprirà mostrando l'home page del tuo sito):

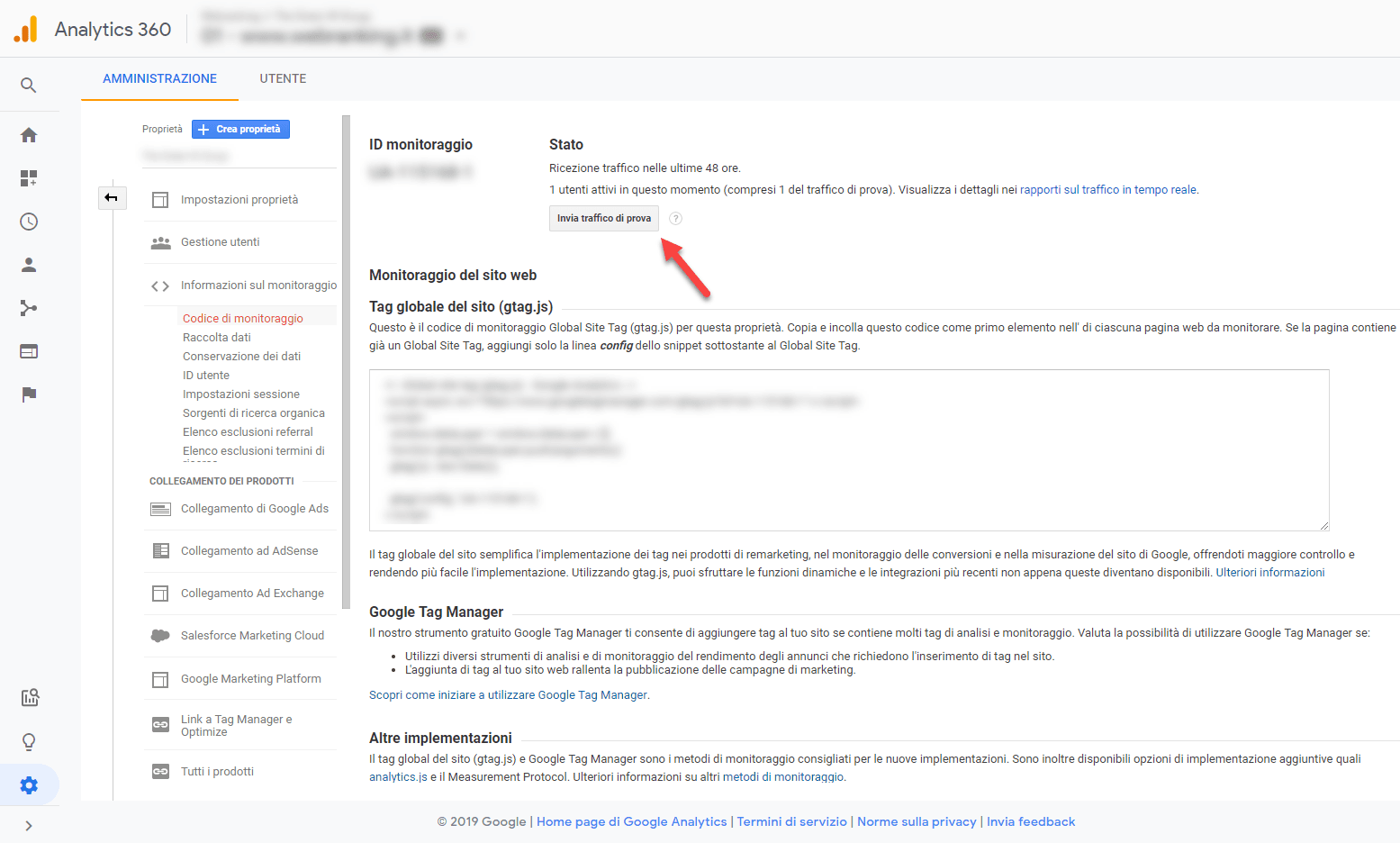

Ora, spostati nella sezione In tempo reale > Panoramica. Se il tracciamento è settato correttamente scoprirai un referral con sorgente analytics_test:

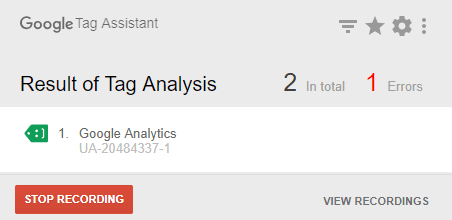

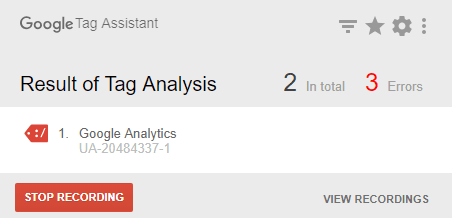

Un'alternativa al metodo riportato sopra prevede l'utilizzo dell'estensione browser Tag Assistant (by Google). Dopo averla installata seleziona Enable e Record, poi digita l'URL del tuo sito nella barra degli indirizzi del tuo browser e digita invio (ti consiglio di ripulire i cookies prima di fare questo test):

Se l'estensione ti segnala un'etichetta verde (primo caso), allora significa che i tracciamenti sono settati correttamente; se, al contrario, l'etichetta segnalata è di colore rosso (secondo caso), allora c'è qualche problema di tracciamento tale per cui Google Analytics non è in grado di ricevere alcuna risposta dal tuo sito.

Oltre all'impostazione del codice di monitoraggio, ci potrebbero essere altre problematiche relative ai tracciamenti.

- Hai verificato che il traffico naturale sia correttamente attribuito al mezzo organico?

- Hai controllato che non ci siano altri script in pagina che impediscono il corretto tracciamento dei dati?

- Sei sicuro di avere impostato correttamente i filtri di analytics?

Verifica su Google Search Console

Tool: Google Search Console.

Google Search Console (il fu Google Webmaster Tools) è uno strumento fondamentale per qualunque SEO specialist o webmaster in quanto fornisce dati estremamente interessanti sullo stato di salute del proprio sito dal punto di vista organico.

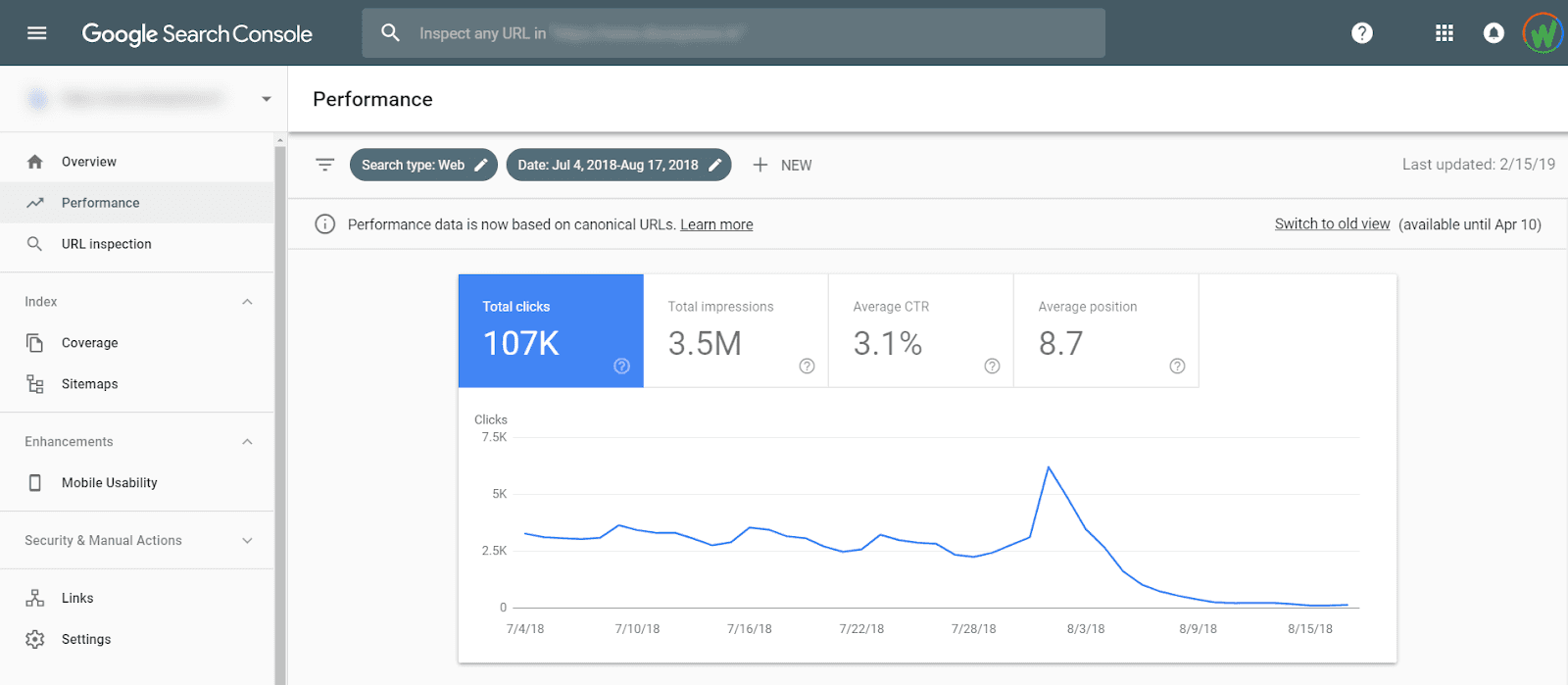

Se il calo di traffico organico fosse reale, allora ci aspetteremmo di trovarlo anche sulla GSC. Apri dunque la dashboard GSC del tuo sito, vai alla sezione Performance e seleziona i click per il periodo in esame:

L'esempio riportato è inequivocabile: il traffico del sito è realmente crollato e non si tratta di un problema di tracciamento dei tool analytics.

Se il calo di traffico fosse solo parziale, avrebbe senso condurre un'analisi approfondita sulle pagine del sito che hanno determinato maggiormente la flessione, così come sulle query di ricerca associate ed eventualmente indagare diminuzioni di impression, CTR o posizionamenti medi.

Nel nostro caso, tuttavia, si tratta di un calo pressoché totale, motivo per il quale dobbiamo continuare la nostra ricerca delle cause che l'hanno generato.

Problemi di scansione da parte dei bot

Tool: Google Search Console, Screaming Frog (o altri software di crawling).

Accertato una volta per tutte il drop di traffico, proviamo ad analizzare possibili problematiche relative al nostro sito partendo dalla verifica della scansionabilità da parte dei bot o crawler.

Dal momento che il traffico organico è quello proveniente dalle SERP dei motori di ricerca, un eventuale impedimento dei loro spider può determinare la scomparsa del nostro sito dai risultati di ricerca e, di conseguenza, l'azzeramento delle visite naturali. È ciò che è successo qualche tempo fa a Barilla.com, che ha involontariamente bloccato l'intero sito per qualche giorno:

Al fine di escludere questo tipo di errori dal nostro sito, per prima cosa verifichiamo che i motori di ricerca possano accedere alle pagine più importanti del nostro sito ispezionando il file robots.txt (digitando www.ilmiofantasticosito.it/robots.txt) oppure aprendo la GSC (nella vecchia versione) andando alla sezione Scansione > Tester dei file robots.txt:

In questo caso il file è impostato in modo tale da lasciare libero accesso (Disallow: ) a qualunque user agent (User-agent: *), compresi i bot dei motori di ricerca.

Tuttavia vi sono casi in cui il file robots.txt potrebbe riportare le seguenti istruzioni:

User-agent: *

Disallow: /

User-agent: googlebot

Disallow: /

Le indicazioni riportate sopra agiscono impedendo a qualunque bot di accedere al sito (esempio 1) e impedendo al bot di Google di accedere al sito (esempio 2).

In entrambi i casi la conseguenza è l'impossibilità da parte dei motori di ricerca di visionare il sito, indicizzarne i contenuti e presentare le pagine web all'interno delle SERP, il che si traduce nell azzeramento (o quasi) del traffico da mezzo organico.

Un sito può impedire l'accesso ai motori di ricerca anche nascondendo i contenuti delle pagine dietro form o campi che richiedono l'inserimento attivo di dati. Siccome i bot non sono in grado di compilare form, tutto ciò che è accessibile previa compilazione sarà invisibile ai motori di ricerca (e dunque non potrà essere trovato dagli utenti sulle SERP).

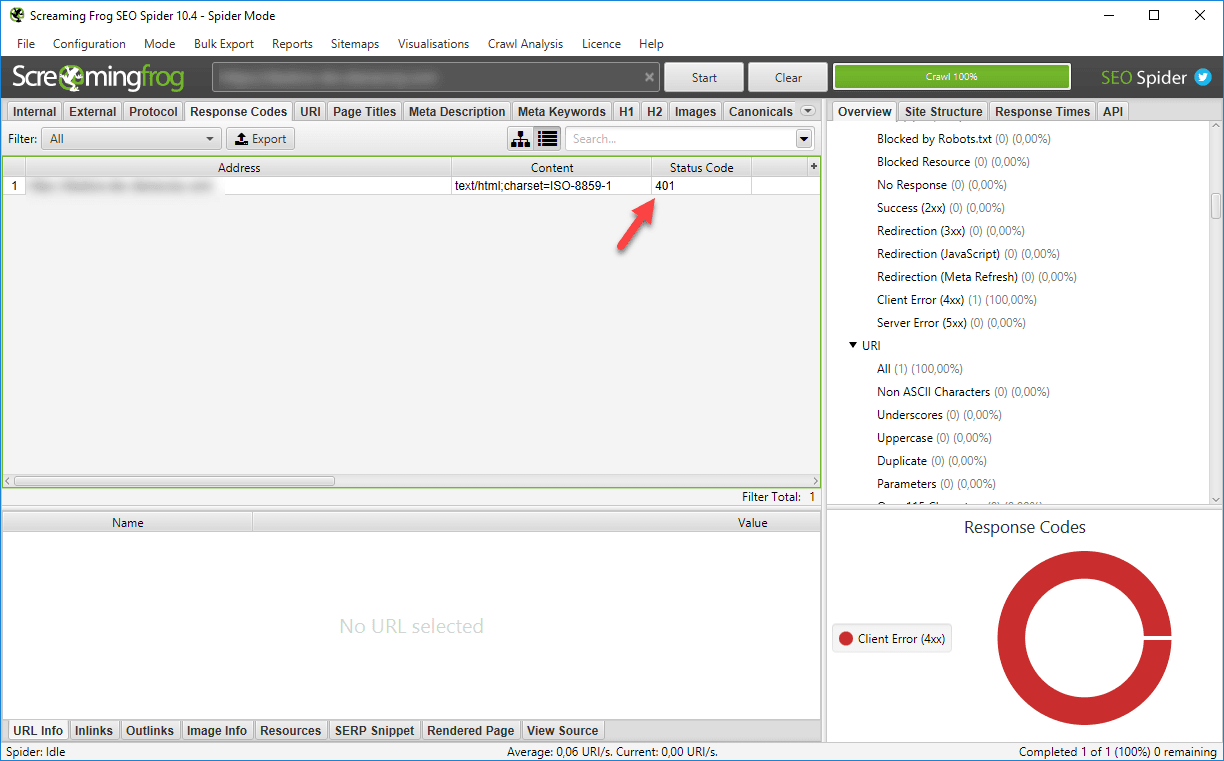

Un modo veloce per individuare la presenza di blocchi alla scansione causati da campi dinamici consiste nell'utilizzare software di web crawling come Screaming Frog. Una volta settato il software, sarà sufficiente inserire il dominio da scansionare e lasciare che il crawler faccia il suo lavoro:

Status code 401 (Unauthorized) o 403 (Forbidden) indicano che la pagina richiesta non può essere mostrata ai crawler in quanto sono necessarie azioni di login o compilazione di campi che i bot non possono compiere.

Infine, un ultimo ostacolo alla scansione del sito da parte dei motori di ricerca si verifica in presenza di errori del server che ne impediscono l'accesso (e solitamente anche gli utenti si trovano impossibilitati ad accedere al sito). Anche in questo caso la scansione con un software di web crawling ci aiuterà a individuare eventuali errori che si presenteranno in forma di status code 502 (Bad Gateway), 503 (Service Unavailable), 504 (Gateway Timeout) o simili.

Problemi di indicizzazione

Tool: Screaming Frog.

Se il tuo sito non presenta problemi di scansionabilità, un'altra potenziale causa da indagare ha a che fare con l'indicizzabilità, ovvero la possibilità che i motori di ricerca salvino nel proprio indice i risultati del tuo sito per poi proporli nelle SERP.

Tipicamente l'indicizzazione delle pagine web può essere impedita attraverso l'inserimento in pagina del meta robots noindex:

Un'alternativa è l'inserimento dell'elemento X-Robots-Tag nell'intestazione dell'header HTTP della pagina:HTTP/1.1 200 OK

Date: Sun, 10 Mar 2019 15:23:43 GMT

(…)

X-Robots-Tag: noindex

(…)

Entrambi i metodi comunicano ai bot che la pagina in questione, pur essendo scansionabile, non dev'essere riportata negli indici dei motori di ricerca e, dunque, nelle loro SERP. La conseguenza è che gli utenti non troveranno mai il risultato e non atterreranno mai su quella pagina dai motori di ricerca.

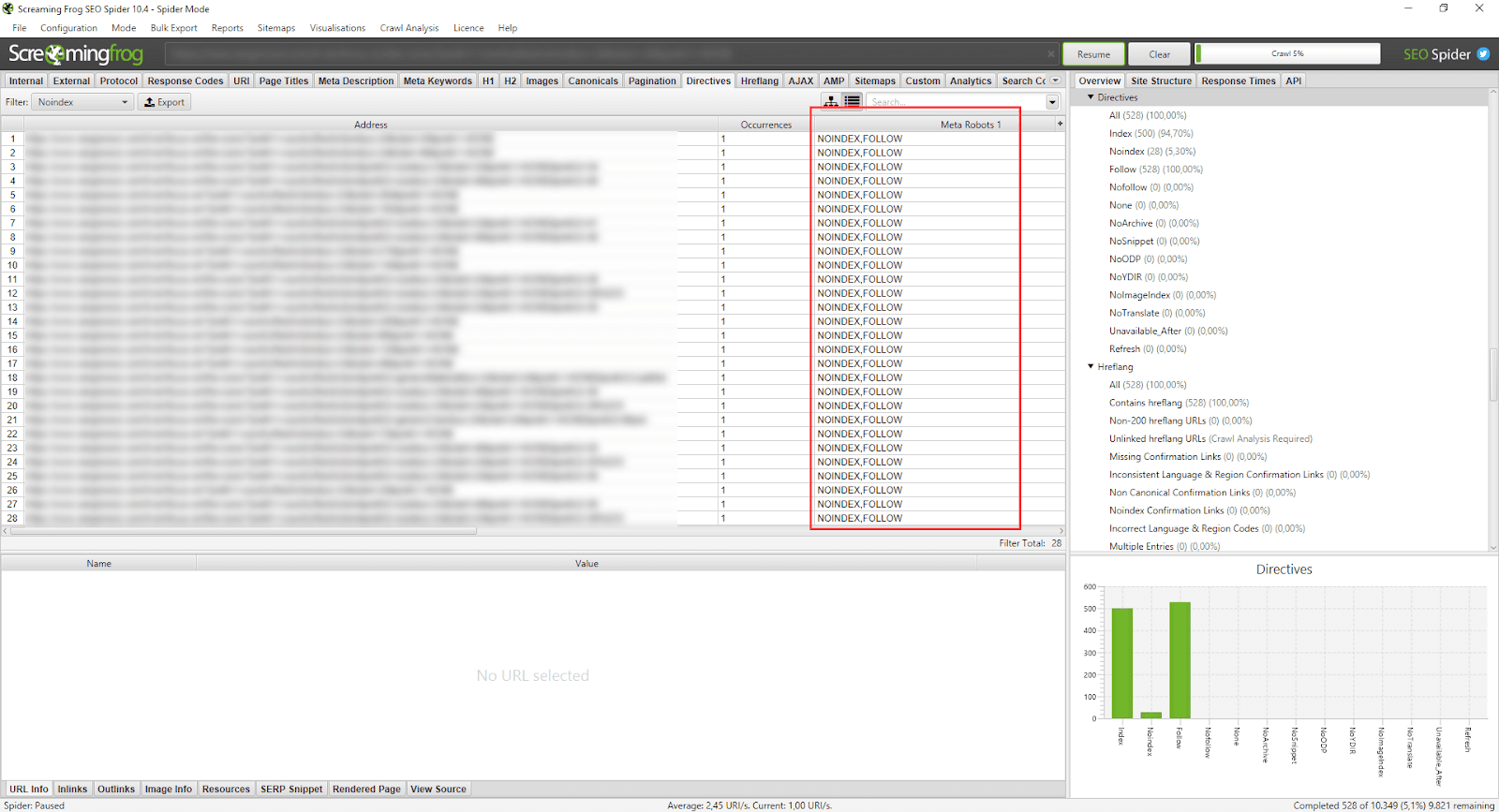

Il modo più semplice per verificare che i contenuti più importanti del tuo sito siano effettivamente indicizzabili è utilizzare Screaming Frog. Anche in questo caso sarà sufficiente inserire il dominio da analizzare nella finestra del software e lasciare che il crawler navighi tra le pagine del sito:

Se le pagine principali del nostro sito non riportano l'indicazione noindex (o se riportano il valore index), possiamo tirare un momentaneo sospiro di sollievo e continuare la nostra analisi.

Presenza di contenuti duplicati

Tool: Google Search Console.

Da diversi anni Google pone attenzione alla questione dei contenuti duplicati che possono costituire un problema non solo in termini di crawl budget (perché mai Google dovrebbe sprecare tempo e denaro per scansionare due o più pagine identiche?), ma anche in termini di esperienza di navigazione per gli utenti (che si scoprirebbero confusi di fronte a più pagine uguali).

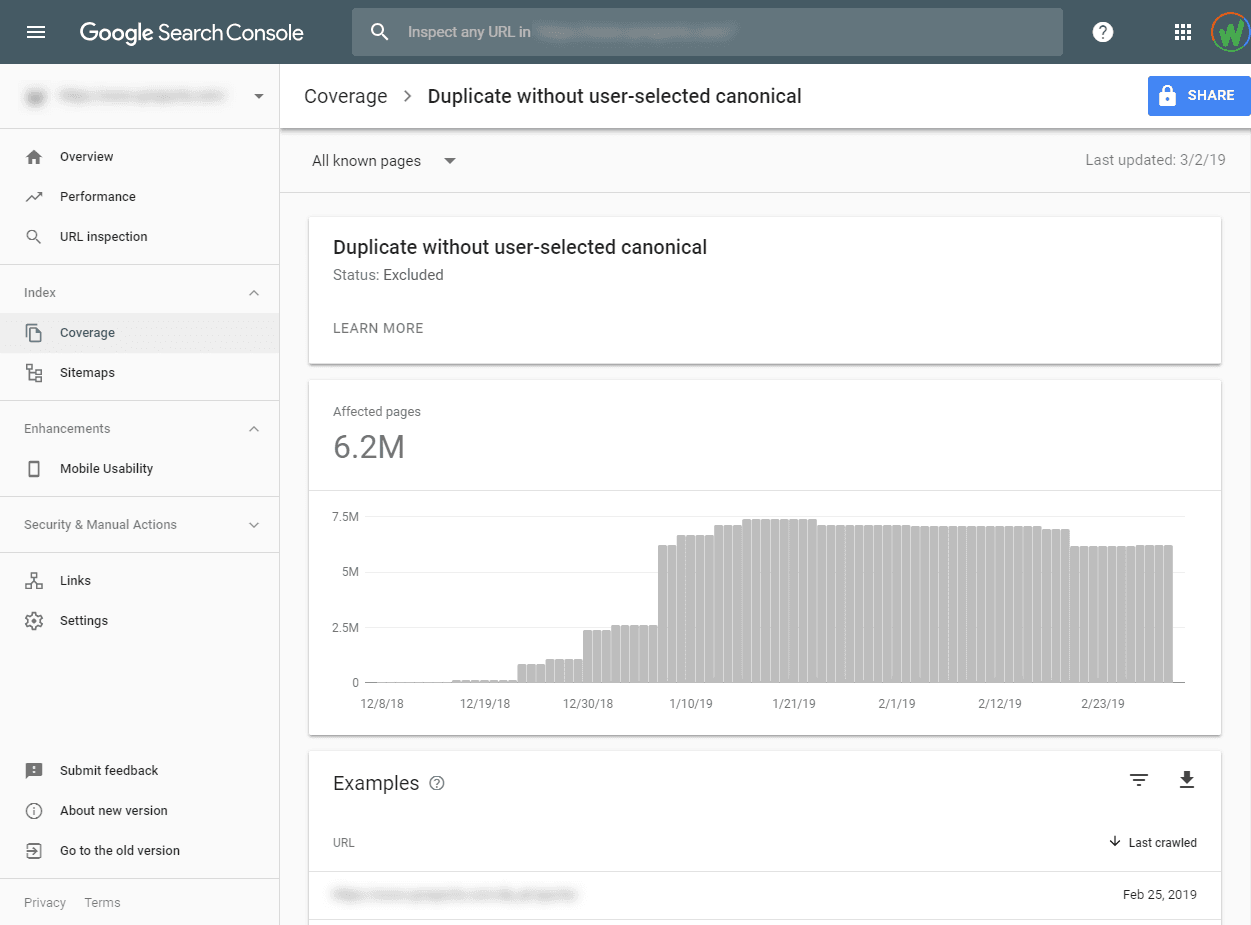

Un modo agile per individuare contenuti che Google reputa troppo simili o duplicati consiste nell'aprire Google Search Console e, nella sezione Copertura, verificare la presenza di URL non indicizzati perché ritenuti duplicati:

Una volta individuati i casi specifici, è fondamentale gestire al meglio eventuali contenuti simili o duplicati. Ad esempio, è suggeribile valutare la rimozione di contenuti superflui o l'accorpamento di contenuti troppo simili a favore di una risorsa di riferimento univoca. Un'alternativa può essere la gestione della compresenza di contenuti duplicati attraverso alcune indicazioni, come:

- il tag rel="canonical", che indica ai motori di ricerca che la versione canonica o principale di un contenuto risiede su un URL specifico;

- il meta robots="noindex", che segnala ai motori di ricerca che l'URL in questione non dev'essere indicizzato;

- la gestione dei parametri URL tramite Google Search Console, che indica a Google come interpretare e gestire eventuali parametri che potrebbero causare la duplicazione dei contenuti.

In ogni caso la linea guida è sempre quella: cerchiamo sempre di semplificare la vita ai motori di ricerca presentando contenuti unici e di valore.

Migrazione mal gestita

Tool: Screaming Frog.

Sempre più spesso in Webranking ci capita di assistere a migrazioni parziali o totali di siti non gestite correttamente, con la conseguenza che tutto il duro lavoro svolto per rendere un sito ottimizzato svanisce nel giro pochi redirect.

La soluzione più indicata e veloce per la migrazione di un sito risiede nei reindirizzamenti lato server, in particolare attraverso lo status code 301 (Moved Permanently). Con questo codice di stato il server comunica al client che la risorsa cercata non è più presente all'URL richiesto e che d'ora in poi potrà essere raggiunta al nuovo URL indicato.

Attenzione però: implementare la giusta soluzione di reindirizzamento potrebbe non essere sufficiente a salvarti da una migrazione mal gestita. Spesso infatti assistiamo a gestioni poco coerenti, come:

- reindirizzamento verso URL non esistenti

- reindirizzamento in bulk verso l'home page del nuovo sito

- reindirizzamento verso pagine che presentano un contenuto diverso rispetto a quello di partenza

È di fondamentale importanza assicurarsi che la vecchia risorsa trovi corrispondenza in quella nuova, al fine di mantenere i posizionamenti precedentemente acquisiti nelle SERP e di offrire sempre il contenuto più adatto a utenti e bot. Pensa che pasticcio se il vecchio path URL /donna/sneakers-basse/ venisse reindirizzato al nuovo path URL /donna/minigonne/ !

In casi come questi non me la sentirei di biasimare Google se decidesse di rimuovere il risultato dalle sue SERP!

Anche in questo caso, il metodo più veloce e preciso per controllare la bontà di una migrazione consiste nell'utilizzare Screaming Frog per verificare che i vecchi URL siano stati reindirizzati con status code 301 al nuovo e corrispettivo URL:

Mobile-friendliness

Tool: Google Mobile-Friendly tester.

Ok, di controlli ne abbiamo già fatti parecchi ma finora pare che niente funzioni; proviamo dunque a cambiare prospettiva.

A partire da marzo 2018, Google ha iniziato a rilasciare il Mobile-first Index aggiornando il proprio indice di ricerca prioritizzando quello mobile. Questo significa che in presenza di due versioni del tuo sito — una desktop e l'altra mobile — Google tenderà a considerare quella mobile come versione di riferimento per l'indicizzazione dei tuoi contenuti sul motore di ricerca.

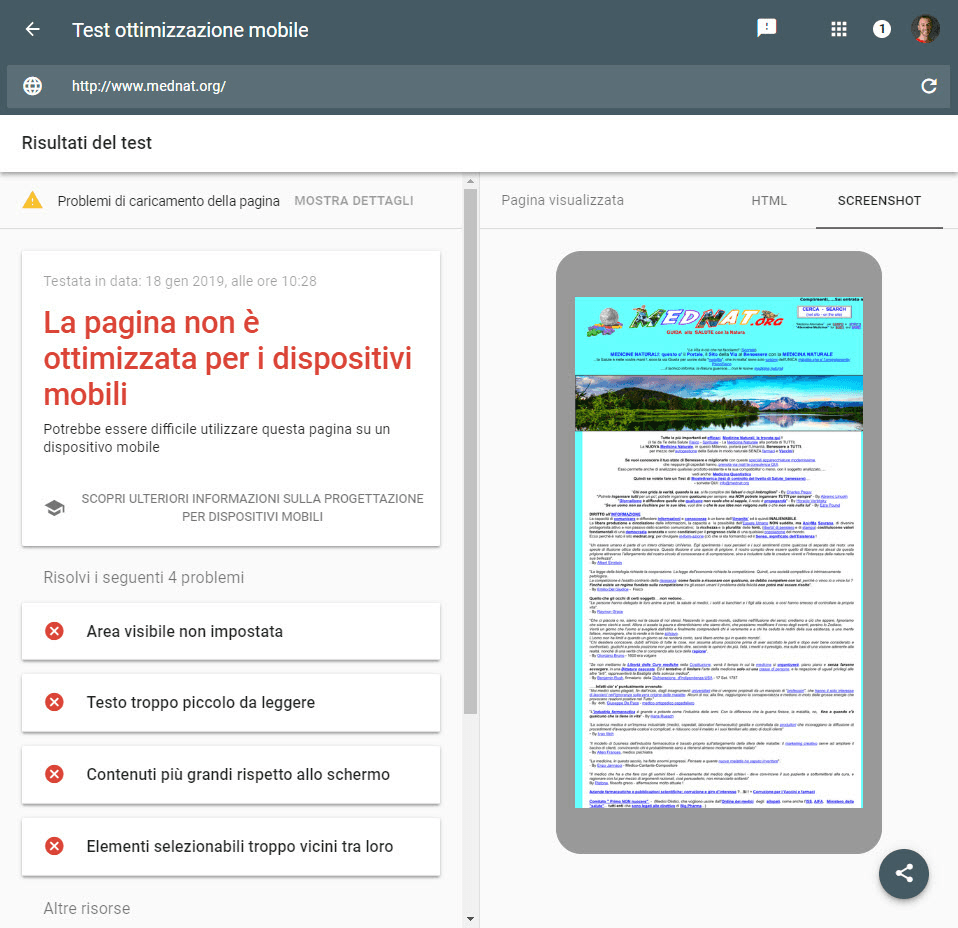

Potrà sembrare banale, ma ad oggi ancora molti siti non risultano ottimizzati per la fruizione da mobile. Per verificare se il tuo sito è mobile-compliant per Google ti basta utilizzare il Test di ottimizzazione mobile inserendo l'URL di una pagina, come nell'esempio che segue:

Basta poco per capire perché siti come quello riportato sopra non siano considerati validi da parte di Google: contenuti inadatti a un piccolo schermo, link e call-to-action difficili da premere, user interface tutt'altro che di supporto per la navigazione… Per non parlare dei tempi di caricamento che, in questo caso, superano i 30 secondi!

Se anche il tuo sito risulta non ottimizzato per la fruizione da mobile, allora potresti avere individuato una ragione che possa spiegare il calo di traffico organico: Google potrebbe non considerare il tuo sito come sufficientemente soddisfacente per gli utenti.

Aggiornamenti delle SERP

Tool: Semrush, SearchMetrics, Sistrix (o altre SEO suite).

Se c'è una cosa che la comunità SEO mondiale ha imparato col tempo è l'imprevedibilità degli aggiornamenti dell'algoritmo di Google e, al contempo, la loro pericolosità per i webmaster. Non è una novità che Google faccia degli aggiustamenti al proprio algoritmo — Moz stima dai 500 ai 600 aggiornamenti annuali, quasi 2 al giorno in media! Questi update possono toccare diversi aspetti dell'algoritmo, ma tutti vanno nella direzione di migliorarlo e di renderne il comportamento sempre più simile a quello dell'utente.

Quasi sempre la conseguenza di questi aggiornamenti è un ricalcolo del valore attribuito ai vari risultati presenti nell'indice di Google, che spesso si traduce in un ricalcolo dei posizionamenti all'interno delle SERP.

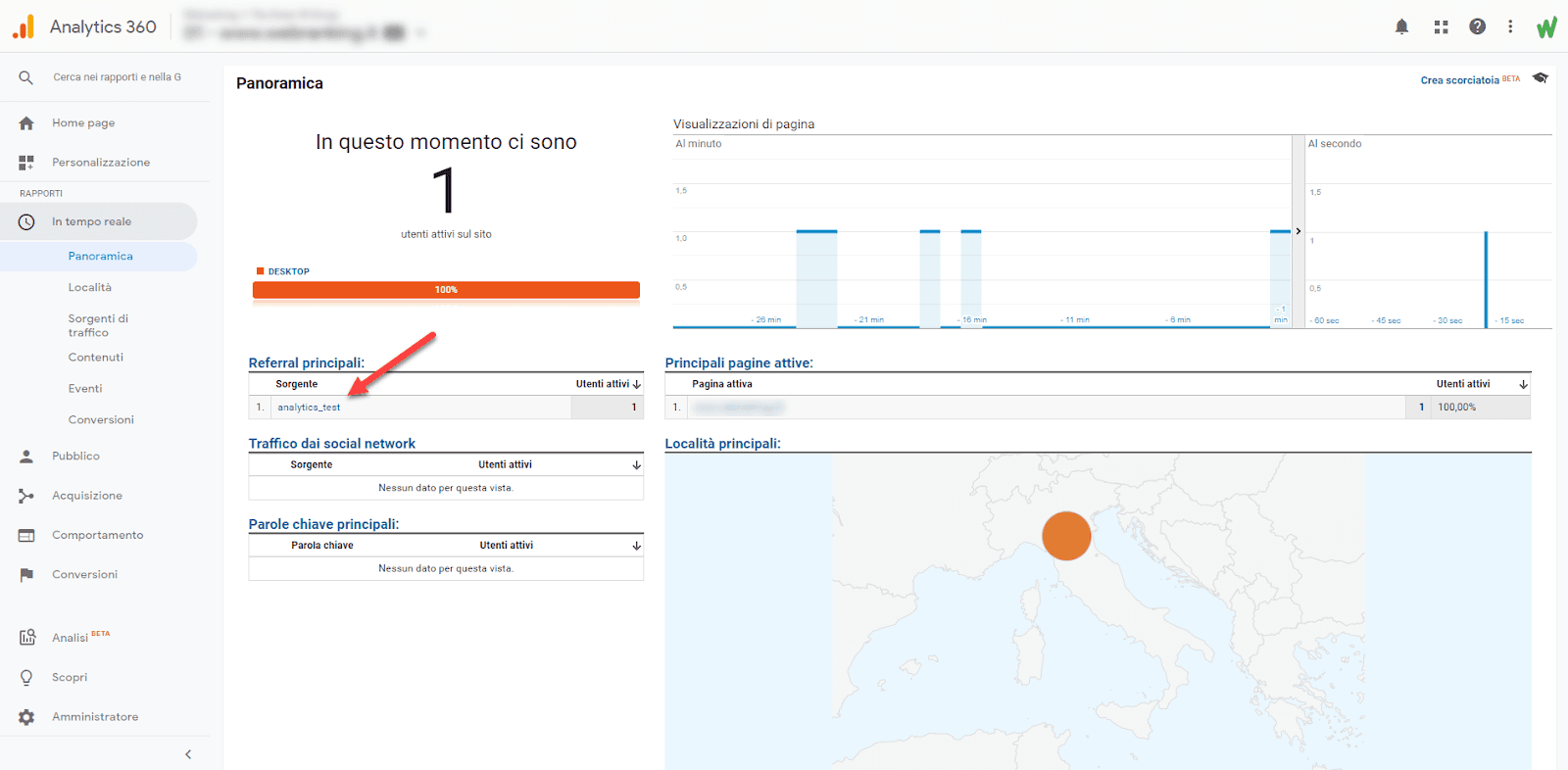

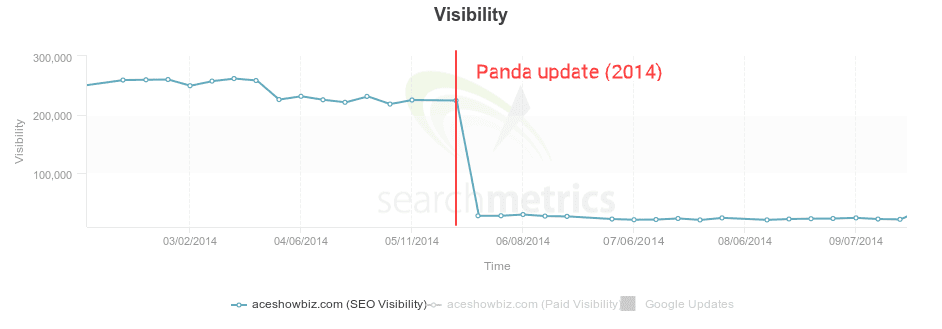

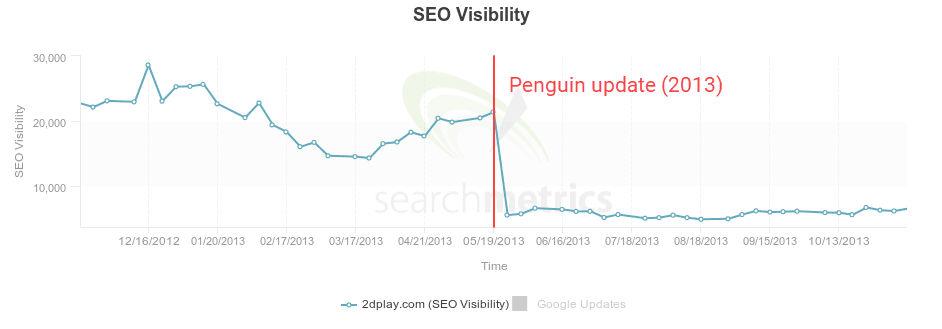

Uno dei primi e più importanti aggiornamenti rilasciati è stato il Google Panda Update che, a partire dal 2011 e in più riprese, ha scombussolato le SERP internazionali. A essere presi di mira da questo aggiornamento sono stati i siti che presentavano qualità scadente, come duplicazione di contenuto o "thin content" cioè contenuti scarsamente informativi e poco utili per l'utente. Di seguito il crollo di traffico di un sito colpito dal Panda Update:

Il più recente e discusso tra gli aggiornamenti è stato il Google Medic Update, rilasciato ad agosto 2018. Rispetto ad altri core update, questo aggiornamento è stato permeato dal dubbio fin dalla sua prima comparsa dal momento che Google, pur avendo confermato il rollout di un update, non ha mai spiegato in dettaglio cosa fosse attaccato da questo aggiornamento. Webranking ha dedicato un articolo dettagliato sul Google Medic Update, le principali evidenze e le sue conseguenze sulle SERP, per cui ti rimando a questo post per approfondire il tema.

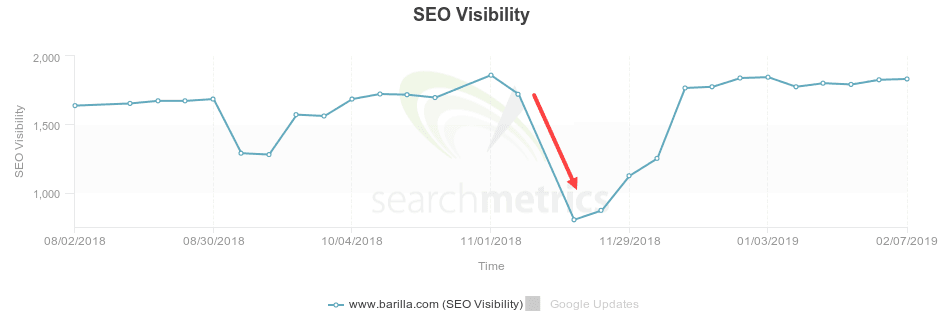

Di seguito un esempio di sito colpito pesantemente dal Medic Update:

- verifica se ci sono stati dei ricalcoli nei posizionamenti all'interno delle SERP con tool come Algoroo, Semrush Sensor o MozCast

- controlla se i tuoi posizionamenti hanno subito variazioni e confrontali con quelli dei competitor — solitamente per un sito che perde visibilità ce n'è almeno uno che guadagna.

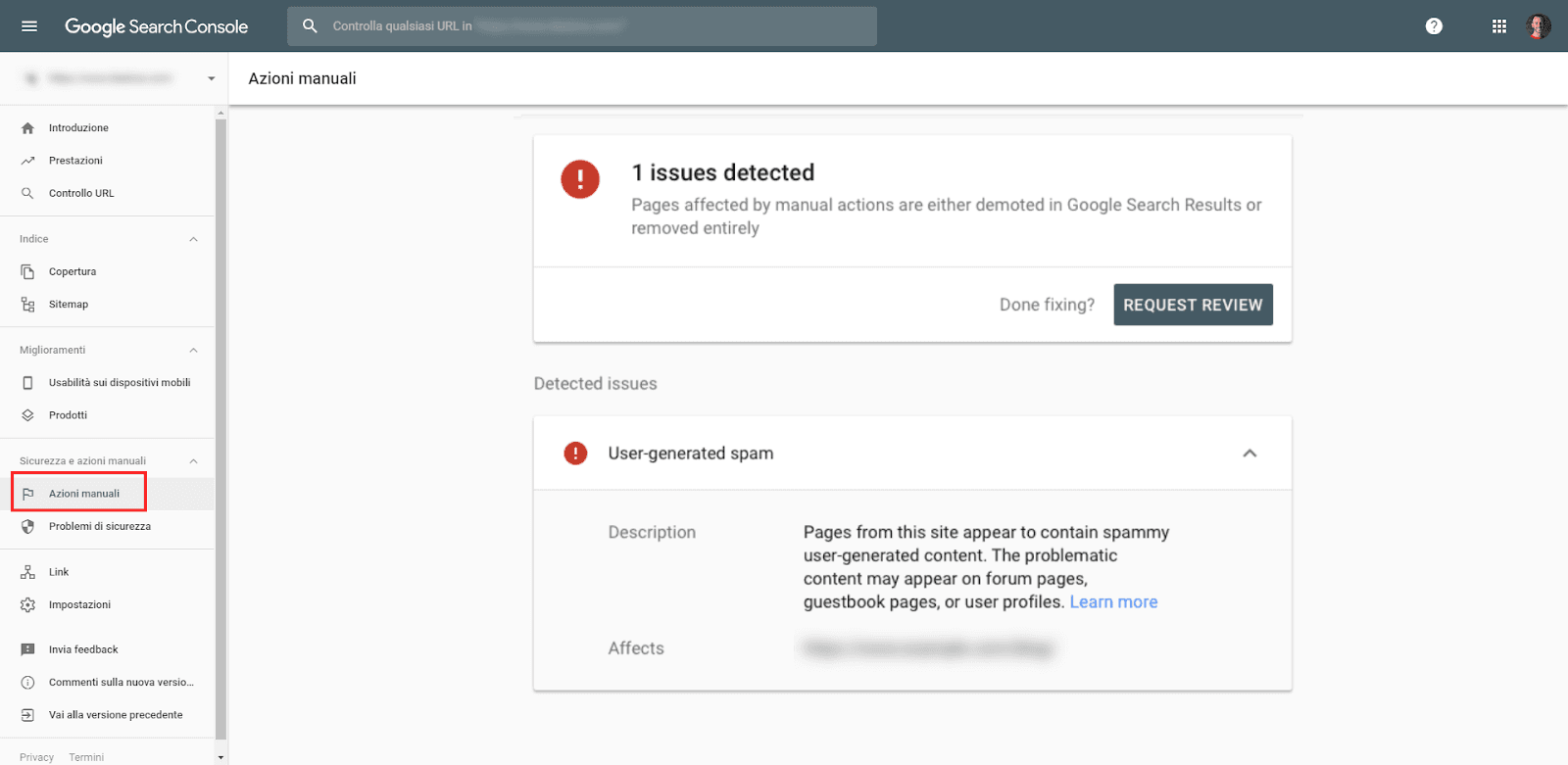

Penalizzazione manuale

Tool: Google Search Console.

Troppo spesso confuse con gli aggiornamenti di Google, le penalizzazioni manuali sono un'altra possibile causa del crollo di traffico da mezzo organico di molti siti. La differenza sostanziale sta nel fatto che le penalizzazioni sono il frutto di un controllo da parte di un team interno a Google che valuta la qualità di un sito web scovando eventuali pratiche che vanno contro le linee guida di Google, come l'acquisizione di link innaturali, cloaking, contenuti spammosi e così via. Il risultato di un'azione di penalizzazione manuale tipicamente è la scomparsa dei risultati di un sito dalle SERP di Google, con conseguente riduzione di accessi da organico.

Il modo più rapido e certo per capire se il tuo sito è stato bersaglio di un'azione manuale consiste nel verificare la presenza di una segnalazione all'interno di Google Search Console:

In casi come questi l'unica soluzione al problema consiste nel riparare al danno rimuovendo le pratiche scorrette segnalate e inviare la richiesta di riconsiderazione per far sì che i propri risultati vengano ristabiliti nell'indice di Google.

La fase di revisione da parte di Google può richiedere da pochi giorni a diverse settimane, per cui il mio consiglio è quello di evitare sempre e comunque pratiche di black hat SEO che possono fare davvero male al proprio sito.

Cannibalizzazione paid

Tool: Google Analytics, Google Ads, Google Search Console.

A volte la minaccia al traffico organico del proprio sito potrebbe provenire non dall'esterno, ma dall'interno… È quanto accade, ad esempio, quando il bilanciamento tra investimenti in campagne a pagamento e investimenti in SEO è troppo sbilanciato a favore del primo.

Si parla di cannibalizzazione del traffico organico da parte del traffico paid quando le campagne a pagamento del proprio sito o brand risultano talmente forti da togliere visibilità ai risultati organici nelle SERP dei motori di ricerca.

Un consiglio? Bilancia sempre gli investimenti tra campagne a pagamento e SEO e avrai un check in meno da fare!

Conclusioni

Se sei arrivato a questo punto, intanto grazie della pazienza e con buona probabilità dovresti essere riuscito a restringere il campo sulle potenziali cause che hanno portato al calo di traffico organico verso il tuo sito. A volte può trattarsi semplicemente di una svista, altre volte possono intervenire fattori esterni, ma spesso capita che siano più fattori concomitanti a determinare questo tipo di situazioni.

Ma se nemmeno questa guida fosse riuscita a risolvere il tuo problema (sicuro?) o se volessi approfondire uno dei temi trattati, possiamo aiutarti a trovare la soluzione per ripristinare lo stato delle cose.

Questo articolo è stato scritto da Fabio Gelmini, SEO Specialist, per il blog di Webranking.